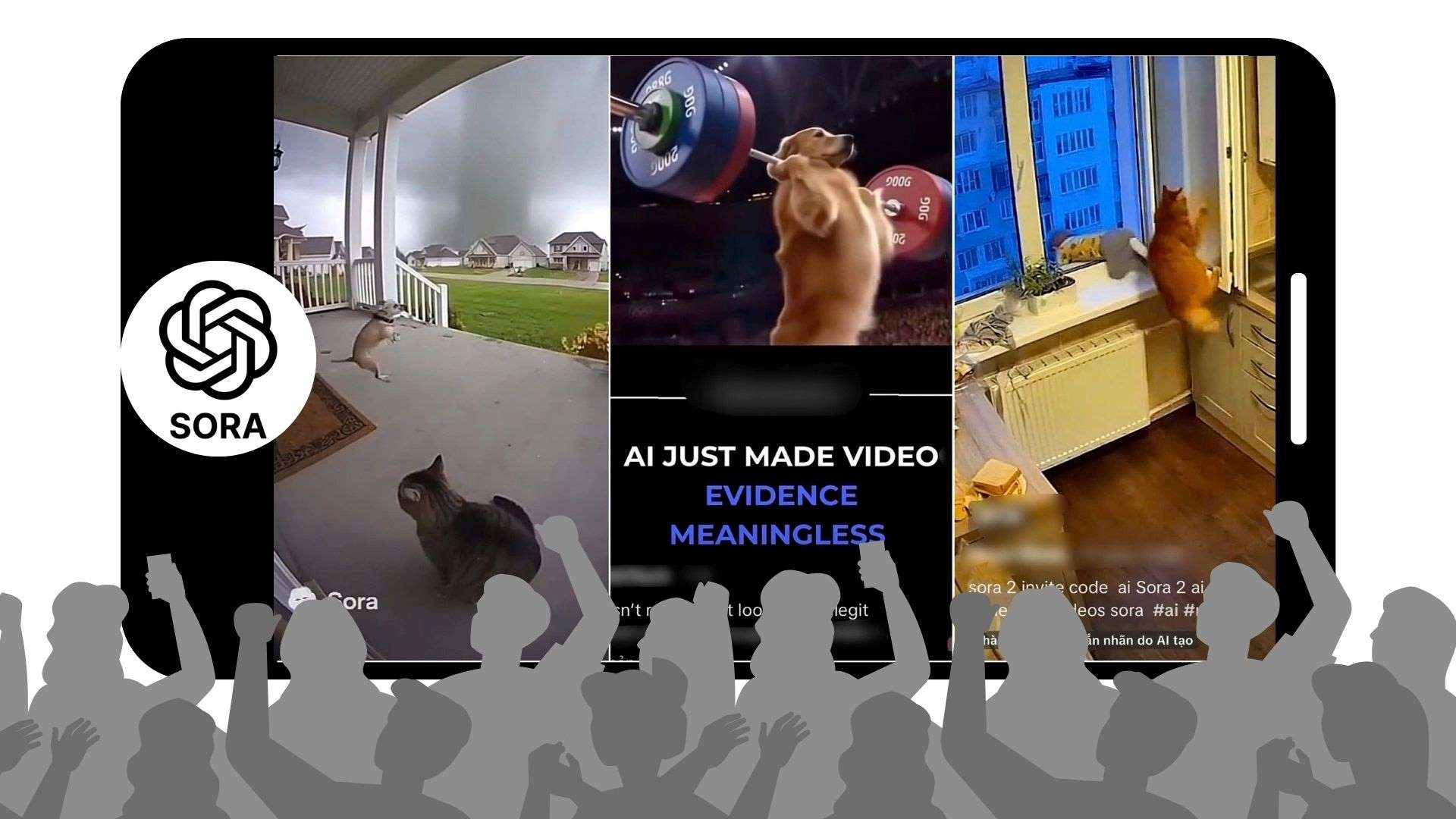

OpenAI가 개발한 인공 지능(AI)으로 비디오를 만드는 앱인 소라의 출시는 보는 사람이 가짜인지 알아보기 어려운 비디오를 만들 수 있다는 점에서 세계에 큰 도전 과제입니다. 이 무료 앱은 앱 스토어에서 다운로드 횟수 기록을 빠르게 달성했으며 온라인 이미지와 비디오의 진위 여부에 대한 우려를 불러일으켰습니다.

처음에는 사용자들이 소라를 재미있는 비디오를 만드는 비디오 엔터테인먼트 도구로 보았습니다. 그러나 이 기술은 허구 뉴스 가짜 사건부터 개인을 비방하는 비디오까지 가짜 비디오를 제작하는 데 빠르게 악용되었습니다. 미국 캘리포니아 대학교의 렌 응 교수에 따르면 '우리는 우리가 보는 것까지 의심하는 법을 배워야 합니다.

브리아 소라는 소셜 네트워크에서 센세이션을 일으켰을 뿐만 아니라 사용자가 만든 수많은 비디오가 영화 및 캐릭터 저작권 침해 징후를 보여 할리우드를 분노하게 만들었습니다. 이러한 반응에 대해 브리아 오픈AI CEO 샘 알트먼은 회사가 저작권 소유자가 사용된 콘텐츠를 제어하고 수익을 창출할 수 있는 메커니즘을 추가할 것이라고 밝혔습니다.

소라는 또한 TikTok, Instagram, YouTube Shorts의 모든 비디오가 이제 가짜일 수 있다는 우려를 불러일으켰습니다. 언론인 브라이언 X. 첸은 단 한 시간의 프리다 테스트 만에 보험을 속이기 위한 가짜 사고 비디오나 잘못된 콘텐츠의 가짜 정보를 만들 수 있었다고 말했습니다. OpenAI가 워터마크(흐릿한 이미지)와 프리다 식별 코드를 부착했지만 많은 사람들이 여전히 쉽게 삭제하거나 편집할 수 있습니다.

기술 전문가 Lucas Hansen은 '우리는 더 이상 비디오가 모두 사실이라고 믿는 사람이 없는 시대로 접어들고 있습니다.'라고 말했습니다. 기술에 약간의 작은 오류라도 있지만 전문가들은 AI가 곧 실제 영화처럼 완벽한 비디오를 만들 것이라고 예측합니다. Hany Farid 교수가 공유했듯이 '소셜 미디어는 이제 가짜 정보의 쓰레기장이며 사람들은 자신이 보는 것까지 의심하는 법을 배워야 합니다.